EU AI Act : Au-delà de la Conformité, un Nouveau Paradigme pour l'Intelligence Artificielle Européenne

Introduction : Le 2 février 2025, un Tournant Historique

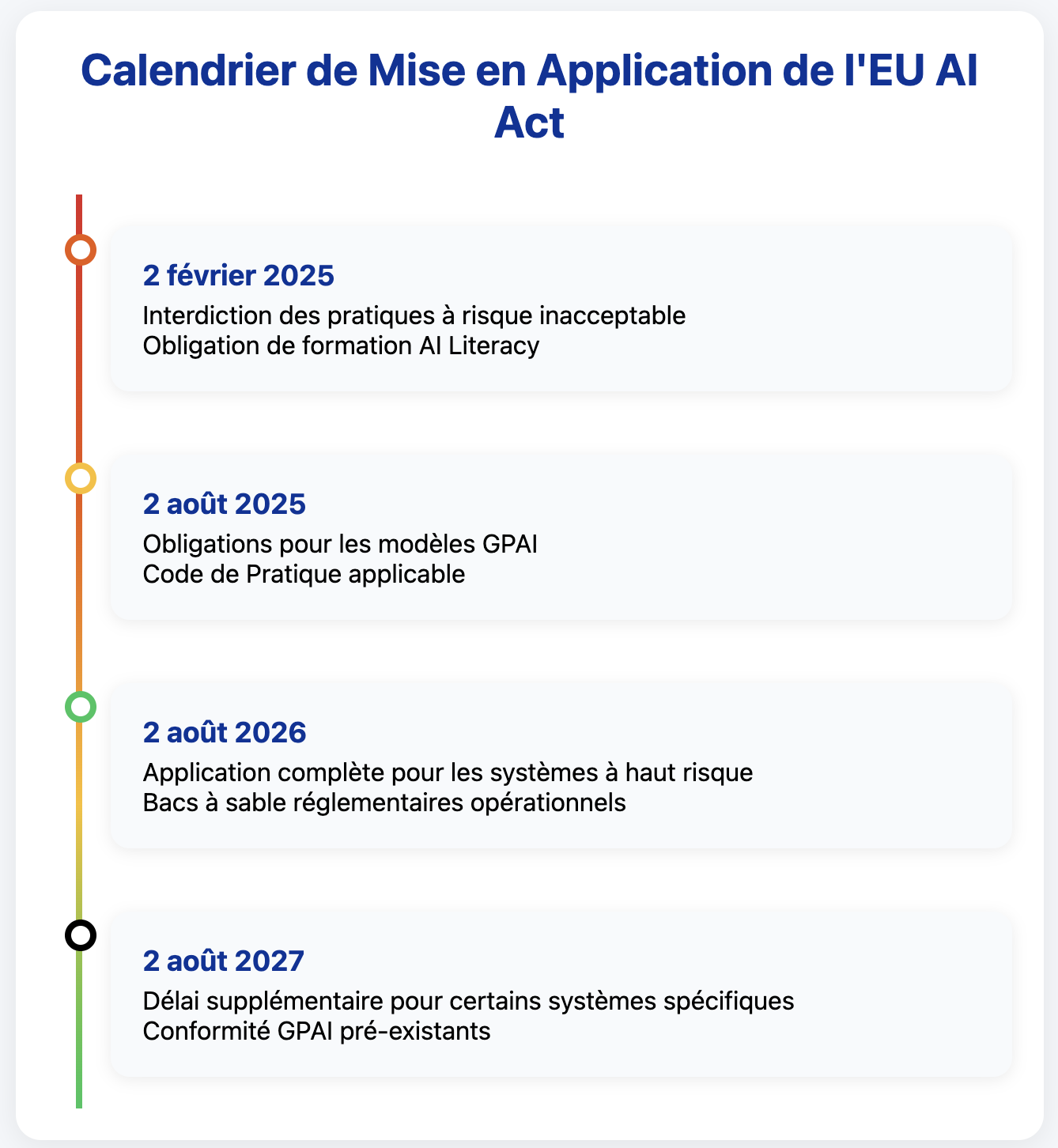

Le 2 février 2025 marquera l'histoire de la régulation technologique européenne. Ce jour-là, les premières dispositions de l'EU AI Act sont entrées en vigueur, interdisant formellement certaines pratiques d'IA jugées incompatibles avec nos valeurs fondamentales. Mais au-delà de ces interdictions symboliques, c'est tout un écosystème réglementaire qui se met en place, redéfinissant notre rapport à l'intelligence artificielle.

En tant que professionnels du RGPD, nous sommes aux premières loges de cette transformation. Après avoir accompagné la révolution de la protection des données personnelles, nous voici face à un défi encore plus ambitieux : encadrer l'intelligence artificielle sans étouffer l'innovation, protéger les citoyens sans handicaper nos entreprises dans la compétition mondiale.

Cette analyse approfondie, fruit de mois de recherche et d'échanges avec les acteurs du terrain, vise à dépasser les approches superficielles pour explorer les véritables enjeux de l'AI Act. Car derrière les obligations techniques se cache une vision civilisationnelle : celle d'une Europe qui refuse de sacrifier ses valeurs sur l'autel de l'efficacité algorithmique.

I. La Philosophie de l'AI Act : Une "Troisième Voie" Européenne

Le Rejet des Modèles Américain et Chinois

L'approche européenne de l'IA se distingue fondamentalement des deux modèles dominants. Là où les États-Unis privilégient l'innovation débridée au nom de la compétitivité économique, et où la Chine instrumentalise l'IA au service du contrôle social, l'Europe trace sa propre voie.

Cette "troisième voie" repose sur trois piliers philosophiques :

1. La dignité humaine inviolable

Héritière de la tradition kantienne, l'Europe place la dignité humaine au sommet de sa hiérarchie de valeurs. L'interdiction des systèmes de notation sociale ou de manipulation subliminale en découle directement. Peu importe leur efficacité potentielle : certaines lignes rouges ne peuvent être franchies.

2. L'innovation responsable

Contrairement à une idée reçue, l'AI Act ne vise pas à freiner l'innovation mais à la canaliser. L'hypothèse sous-jacente est que la confiance constitue un avantage concurrentiel durable. Les entreprises qui sauront développer une IA éthique et transparente gagneront la confiance des consommateurs et des partenaires.

3. La souveraineté par les normes

Face aux géants américains et chinois, l'Europe mise sur sa capacité normative. Comme avec le RGPD, l'objectif est d'imposer nos standards au niveau mondial par un "effet Bruxelles" qui force les acteurs globaux à s'aligner sur nos exigences.

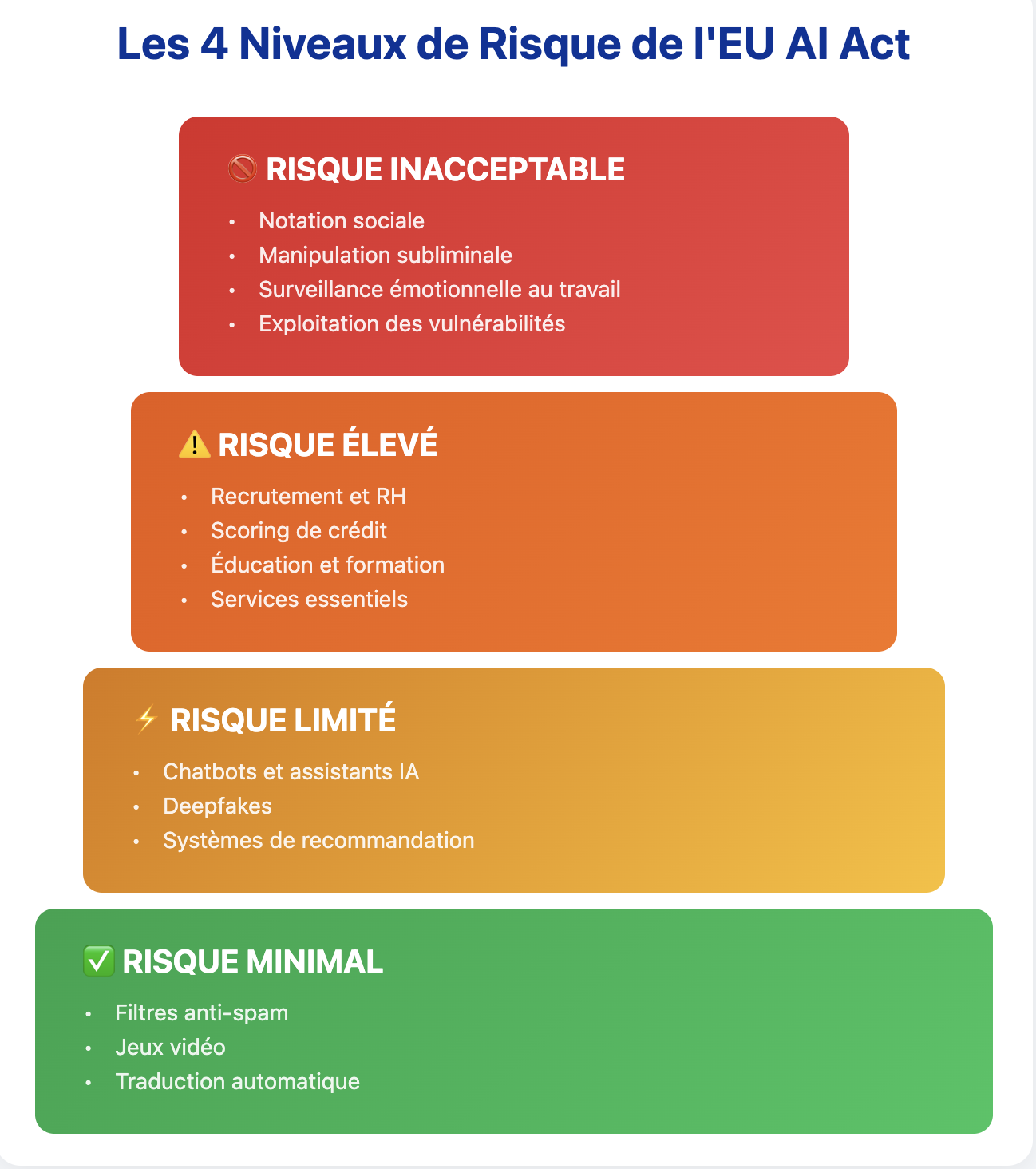

L'Approche par les Risques : Une Innovation Réglementaire

L'architecture de l'AI Act repose sur une classification sophistiquée en quatre niveaux de risque. Cette approche graduée évite l'écueil d'une régulation uniforme qui étoufferait l'innovation tout en protégeant efficacement contre les dangers réels.

Les pratiques interdites depuis le 2 février révèlent nos valeurs cardinales :

- Pas de manipulation inconsciente des comportements

- Pas d'exploitation des vulnérabilités

- Pas de surveillance émotionnelle généralisée

- Pas de crédit social à la chinoise

Ces interdictions ne sont pas de simples précautions techniques mais l'expression d'un choix de civilisation.

II. L'Impact Économique : Entre Mythes et Réalités

Le Paradoxe de la Conformité

L'analyse des premiers mois d'application révèle un paradoxe fascinant. Contrairement aux prédictions catastrophistes, l'AI Act semble favoriser l'émergence d'un écosystème d'innovation européen dynamique.

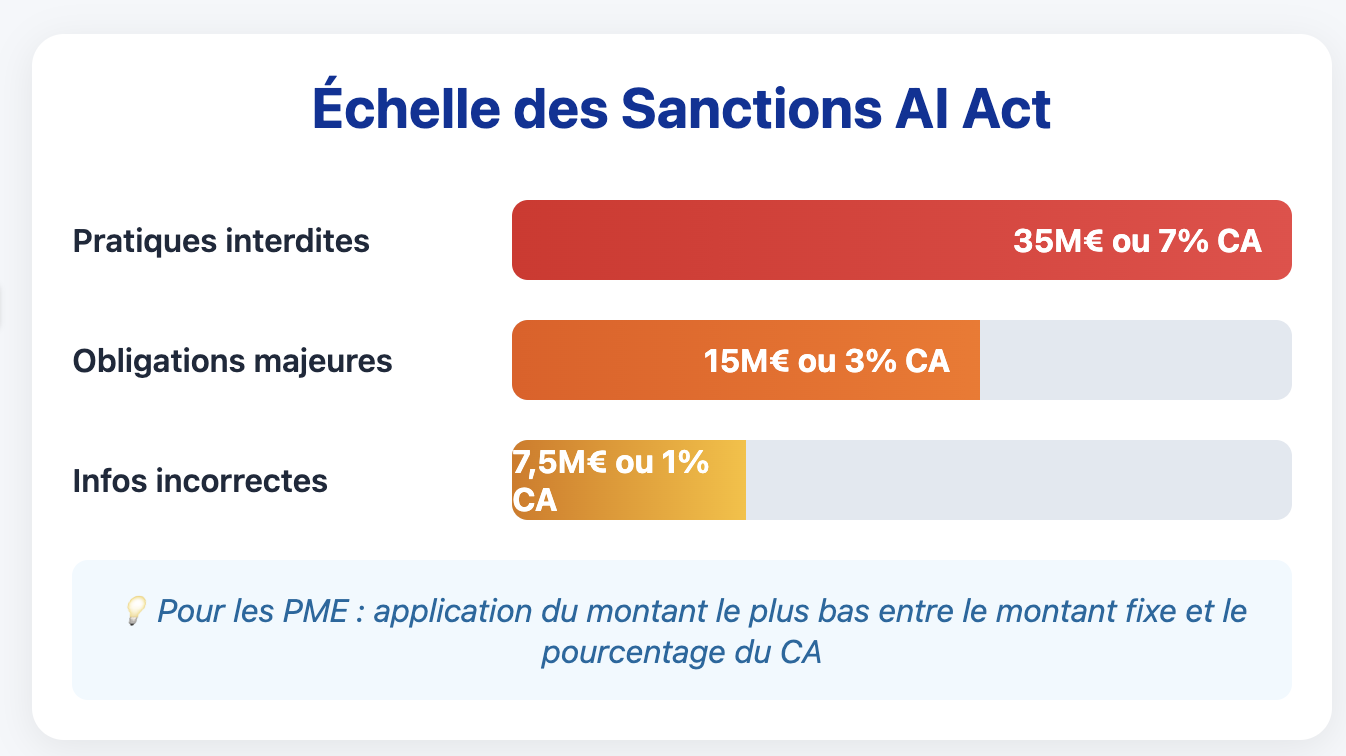

Les coûts de conformité, bien que réels, restent proportionnés. Pour les grandes entreprises, ils représentent moins de 1% du chiffre d'affaires. Pour les PME, des mécanismes de soutien émergent : bacs à sable réglementaires, financements européens, mutualisation des coûts.

Plus intéressant encore : la contrainte réglementaire stimule l'innovation. Les exigences d'explicabilité ont accéléré le développement de nouvelles techniques d'IA interprétable. Les obligations de détection des biais ont donné naissance à tout un secteur de l'IA équitable. Un nouveau marché de la conformité IA, estimé à 2 milliards d'euros d'ici 2027, est en train d'émerger.

L'Effet Bruxelles 2.0 : Une Influence Mondiale

Comme prédit, l'AI Act commence à influencer les régulations mondiales :

- Le Japon a adopté des guidelines largement inspirées de l'approche européenne

- Le Canada reprend notre classification par risques dans son projet de loi C-27

- La Californie intègre des éléments de l'AI Act dans ses propositions législatives

- Même la Chine converge sur certains points (deepfakes, manipulation)

Les entreprises européennes développent une expertise unique en "responsible AI" valorisable globalement. Cette expertise devient un avantage concurrentiel sur les marchés soucieux d'éthique.

La Question des PME : Un Défi à Relever

L'impact est plus significatif pour les PME et startups, avec des coûts de conformité estimés entre 50 000 et 500 000 euros selon la complexité. Cependant, l'écosystème s'adapte rapidement :

- Émergence d'outils open source de conformité

- Templates sectoriels gratuits

- Programmes de formation mutualisés

- Services de conseil spécialisés abordables

Les bacs à sable réglementaires, obligatoires dans chaque État membre d'ici août 2026, permettront aux PME de tester leurs innovations dans un environnement sécurisé.

III. Le Code de Pratique GPAI : Un Modèle de Régulation Collaborative

Une Élaboration Multi-Stakeholder Exemplaire

Le Code de Pratique GPAI, publié le 10 juillet 2025 après consultation de plus de 1000 parties prenantes, représente une approche innovante de la régulation. Pour la première fois, régulateurs, entreprises, société civile et experts ont co-construit ensemble les modalités pratiques de conformité.

Le Code s'articule autour de trois chapitres : Transparence (avec un formulaire standardisé de documentation), Droit d'auteur (orientations sur le respect des droits), et Sûreté/Sécurité (pour les modèles à risque systémique).

Un Instrument de Soft Law Efficace

Bien que volontaire, l'adhésion au Code présente des avantages substantiels : présomption de conformité facilitée, dialogue privilégié avec l'AI Office, période de grâce d'un an pour l'implémentation.

Les signataires du Code bénéficient d'une clarté opérationnelle précieuse, avec des orientations détaillées sur la mise en œuvre concrète des obligations. Cette approche pragmatique contraste avec la rigidité habituelle des textes réglementaires.

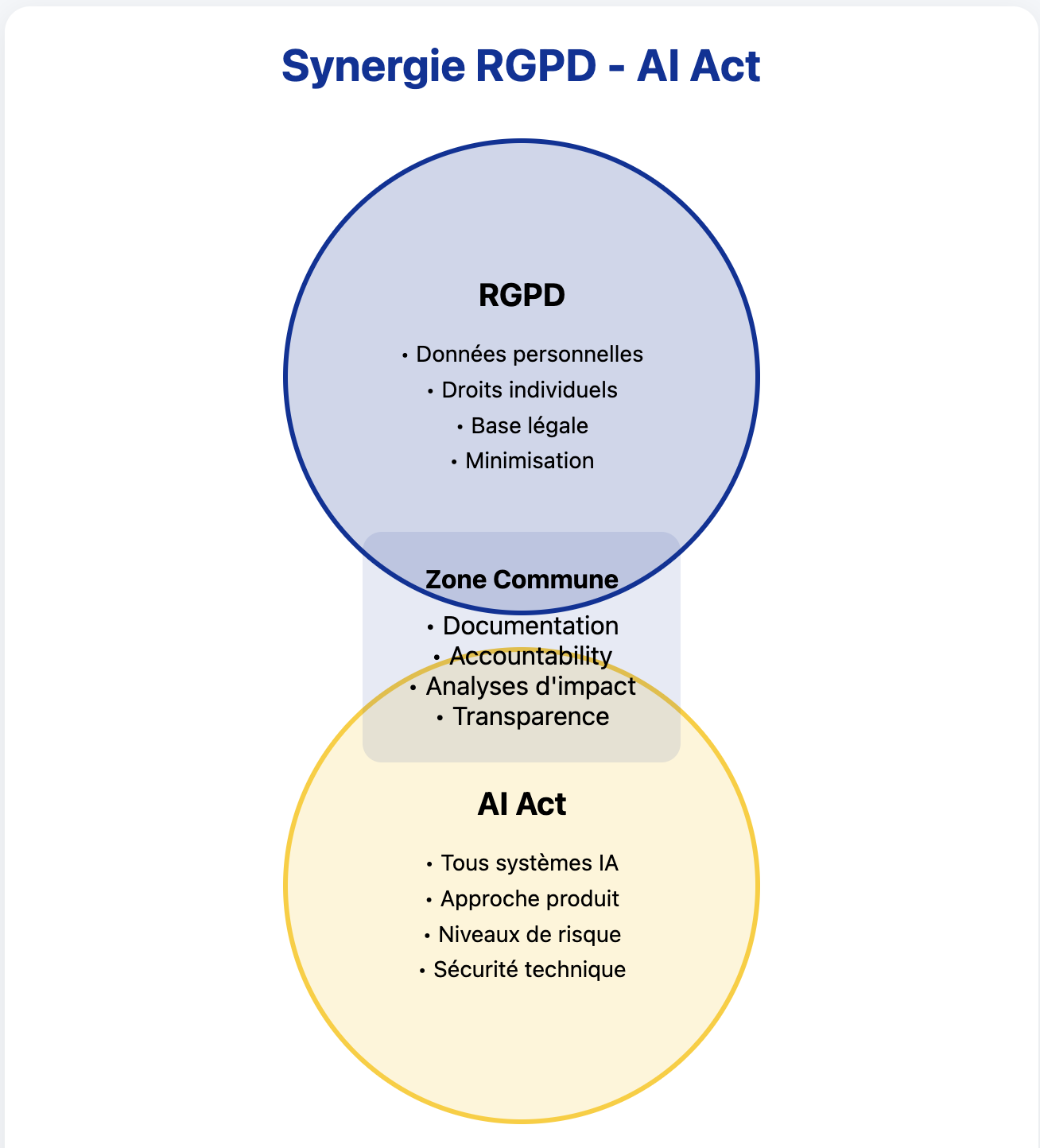

IV. L'Articulation RGPD-AI Act : Synergies pour les DPO

Au-delà de la Coexistence : Une Complémentarité Naturelle

Pour les professionnels RGPD, l'AI Act n'est pas une contrainte supplémentaire mais une extension naturelle de notre mission. Les synergies sont nombreuses :

Principes partagés :

- Approche basée sur les risques

- Accountability et documentation

- Transparence et information

- Protection dès la conception

Outils réutilisables :

- Les AIPD peuvent alimenter les évaluations AI Act

- Les registres RGPD s'étendent naturellement aux systèmes IA

- Les processus de gouvernance existants s'adaptent facilement

Les Nouveaux Défis pour les DPO

Trois défis majeurs émergent de l'articulation RGPD/AI Act : la gouvernance des données d'entraînement (tension entre minimisation et besoins des modèles), l'explicabilité vs. secrets d'affaires, et la gestion de l'extraterritorialité.

Le DPO doit évoluer vers un rôle élargi intégrant :

- Compréhension basique du machine learning

- Capacité d'évaluation des risques algorithmiques

- Interface avec les équipes techniques sur l'éthique

- Conseil sur la classification des systèmes IA

Méthodologie Pratique d'Intégration

1. Cartographie unifiée

Créer un registre intégré documentant à la fois les traitements RGPD et les systèmes IA, avec classification des risques croisés.

2. Processus de validation commun

Une revue unique pour les nouveaux projets évaluant simultanément conformité RGPD et AI Act, évitant la duplication des efforts.

3. Formation transversale

L'obligation d'AI Literacy entrée en vigueur le 2 février 2025 offre l'opportunité d'intégrer protection des données et éthique IA dans un programme unifié.

V. Les Enjeux Civilisationnels : Au-delà de la Technique

La Confiance comme Fondement Économique

L'AI Act reconnaît implicitement que la confiance n'est pas un luxe mais une nécessité économique. Sans confiance, pas de transactions, pas d'adoption technologique, pas de croissance durable.

Cette vision dépasse l'approche purement utilitariste de certains économistes qui voient dans toute régulation un frein à l'efficience. L'Europe parie que la transparence et l'éthique créeront un avantage concurrentiel durable.

Les Limites d'une Vision Court-Termiste

La plupart des études économiques sur l'impact de l'AI Act se focalisent sur les effets à court terme, négligeant les bénéfices à long terme de la confiance et de la stabilité réglementaire.

Les premières données suggèrent que les "chocs" initiaux de conformité s'estompent rapidement, les entreprises s'adaptant et intégrant les exigences dans leurs processus naturels.

Un Modèle pour le Monde ?

L'AI Act représente plus qu'une simple réglementation : c'est l'affirmation qu'une autre voie est possible entre le laisser-faire américain et le contrôle chinois. Cette "troisième voie" européenne pourrait devenir le modèle dominant si elle parvient à concilier innovation et protection.

VI. Guide Pratique : Les Actions Prioritaires pour 2025

Phase 1 : Inventaire et Classification (Immédiat)

1. Cartographier tous vos systèmes IA

- Identifier chaque système utilisé ou développé

- Classifier selon les 4 niveaux de risque

- Prioriser les actions selon l'impact

2. Focus sur les interdictions

Vérifier immédiatement l'absence de : systèmes de manipulation subliminale, exploitation de vulnérabilités, notation sociale, reconnaissance émotionnelle au travail (sauf sécurité), bases de données biométriques non autorisées.

3. Mettre en place l'AI Literacy

Formation obligatoire depuis février 2025 : sensibilisation générale pour tous, formation spécifique pour utilisateurs de systèmes IA, expertise approfondie pour développeurs.

Phase 2 : Préparation GPAI (Avant août 2025)

Pour les utilisateurs de modèles IA généraux (ChatGPT, Claude, etc.), préparer : documentation technique, politique de respect du droit d'auteur, information des utilisateurs, évaluation des risques si modèle > 10^25 FLOP.

Phase 3 : Systèmes Haut Risque (Avant août 2026)

Pour les systèmes classés à haut risque :

- Système de gestion des risques itératif

- Documentation technique complète

- Supervision humaine effective

- Logging et traçabilité

- Tests de robustesse et biais

Outils et Ressources

Templates essentiels :

- Registre unifié RGPD/AI Act

- Checklist de conformité par niveau de risque

- Modèle d'analyse d'impact IA

- Plan de formation AI Literacy

Solutions techniques :

- MLflow (gestion cycle de vie ML)

- SHAP/LIME (explicabilité)

- Fairlearn (détection biais)

- Solutions commerciales intégrées

VII. Perspectives : L'Europe peut-elle Gagner la Course à l'IA Éthique ?

Les Atouts Européens

L'Europe dispose d'avantages uniques dans la course à l'IA éthique :

- Une tradition philosophique valorisant la dignité humaine

- Un écosystème réglementaire mature (RGPD, AI Act)

- Une population sensibilisée aux enjeux de privacy

- Des institutions capables d'imposer leurs standards

Les Défis à Surmonter

Plusieurs obstacles demeurent : retard dans les standards techniques (CEN/CENELEC), difficultés d'harmonisation entre États membres, pénurie de talents spécialisés, résistance de certains acteurs économiques.

La nomination d'Ekaterina Zaharieva comme Commissaire aux Startups et son engagement pour une stratégie européenne de l'innovation suggèrent une prise de conscience au plus haut niveau.

L'Opportunité Historique

Nous sommes à un moment charnière. L'AI Act peut devenir soit un frein à l'innovation européenne, soit le fondement d'un leadership mondial en IA éthique. La différence résidera dans notre capacité collective à :

- Implémenter intelligemment les exigences

- Soutenir les PME dans leur mise en conformité

- Développer des standards techniques pragmatiques

- Former massivement aux compétences IA

Conclusion : Au-delà de la Conformité, une Vision

L'EU AI Act n'est pas qu'une énième réglementation à cocher sur notre liste de conformité. C'est l'expression d'un choix de société fondamental : celui de refuser que l'efficacité algorithmique prime sur la dignité humaine.

Pour nous, professionnels du RGPD, c'est une opportunité unique. Nous avons développé avec le RGPD une expertise précieuse en protection des droits fondamentaux dans le numérique. L'AI Act nous permet d'étendre cette mission à l'ensemble des systèmes algorithmiques qui façonnent notre société.

Les prochains mois seront critiques. Entre l'entrée en vigueur des obligations GPAI en août 2025 et l'application complète en août 2026, nous devons non seulement assurer la conformité technique mais aussi contribuer à façonner une culture européenne de l'IA responsable.

Comme l'a montré le succès du RGPD, l'Europe peut imposer ses standards au monde quand elle allie ambition normative et pragmatisme économique. L'AI Act a ce potentiel. À nous de le concrétiser.

Car au final, la question n'est pas de savoir si nous pouvons nous permettre de réguler l'IA. C'est de savoir si nous pouvons nous permettre de ne pas le faire. Dans un monde où l'intelligence artificielle redéfinit les contours du possible, l'Europe affirme que certaines lignes ne doivent pas être franchies. C'est notre contribution à l'humanité numérique de demain.

Quelle est votre vision de l'AI Act ? Comment votre organisation se prépare-t-elle ? Partageons nos expériences pour construire ensemble une IA européenne digne de confiance.

#AIAct #RGPD #IntelligenceArtificielle #Conformité #Innovation #ÉthiqueIA #ProtectionDesDonnées #TransformationDigitale #Europe #Leadership

Sources et Références

Textes Officiels

- Règlement (UE) 2024/1689 - EU AI Act (JO 12 juillet 2024)

- Règlement (UE) 2016/679 - RGPD

Documents Clés 2025

- Guidelines on prohibited AI practices - Commission européenne (Février 2025)

- Guidelines on GPAI models - AI Office (18 juillet 2025)

- General-Purpose AI Code of Practice - Version finale (10 juillet 2025)

- Template Training Data Summary - Commission européenne (24 juillet 2025)

Analyses et Études

- Conférence CNIL/DG Trésor - "Impact économique du RGPD" (20 mai 2025)

- Carnegie Endowment - "EU's AI Power Play" (2025)

- Epoch AI - Base de données modèles >10^25 FLOP (2025)

Sources Juridiques

- DLA Piper - "EU AI Act's ban takes effect" (2025)

- White & Case - "AI Act becomes law" (2024)

- Covington - Guidelines prohibited practices (2025)

Ressources Pratiques

- AI Act Explorer : artificialintelligenceact.eu

- EU AI Office : digital-strategy.ec.europa.eu/ai-office

- CNIL : cnil.fr/ai-act

Articles de Référence

- Novelli et al. (2025) - "Robust European AI Governance"

- Corporate Europe Observatory (2025) - "Big Tech influence"

- Euronews (2025) - "Is Europe ready to police AI?"

- Sifted (2025) - "EU regulations in 2025"

Sources vérifiées au 1er août 2025

.png)